中文翻译:

机器人需要的不只是代码,更是经验

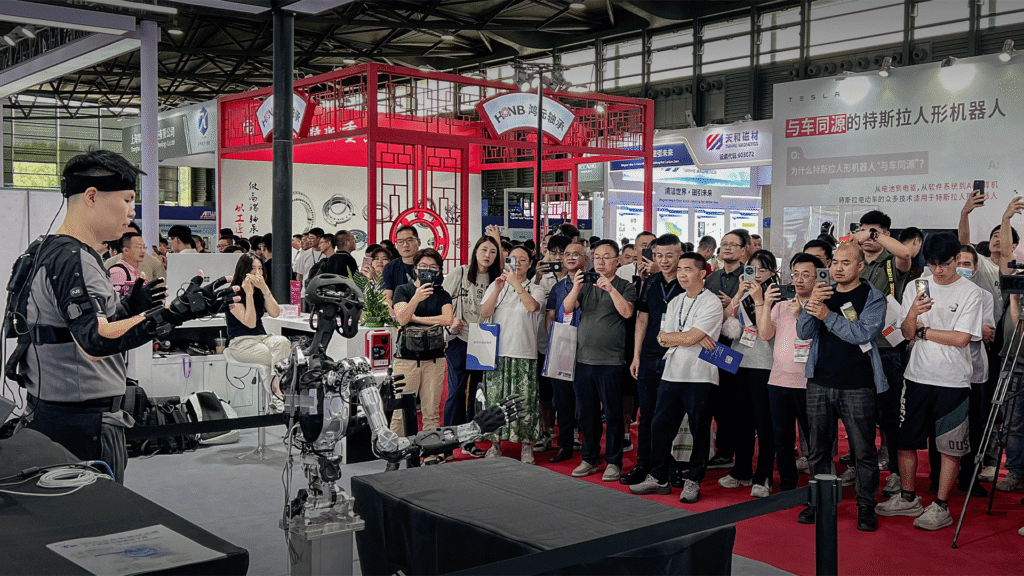

作者:戴若犁博士(Dr. Tristan Dai),Noitom Robotics 创始人兼首席执行官(Founder & CEO)

更直接一点的结论是:在具身智能(Embodied AI)里,决定性能上限的,不是更大的模型,而是更好的经验(experience)。

当我们谈论 AI,话题常常围绕着算法、算力(compute power)与模型架构(model architectures)展开。但对真实存在于物理世界、要与环境稳定交互的智能体而言,系统需要被持续喂入高保真、多模态、时序对齐的真实经验:视觉、听觉、运动与触觉同步融合(synchronized, high-fidelity blend)的数据。一般来说,这类数据只会在人类实际行动于真实环境时自然产生——也就是真实世界的多模态数据(real-world multimodal data)。

这件事有一个名字:sim-to-real gap

在仿真里,机器人学得很快:可渲染近乎完美的 3D 场景,跑数百万次试错循环(trial-and-error loops),把数月训练压到数小时。 问题往往出现在走出仿真之后:现实是不可预测、噪声重、动态多变的。

仿真到现实的鸿沟(sim-to-real gap),就是受控的模拟条件与混杂且传感丰富(sensor-rich)的现实复杂性之间的差异:阳光直射下相机会耀斑;地板会响;物体不会精确落在预期位置;人类行为更是任何先进仿真都难以完全覆盖。

这是当今机器人学的重大挑战之一。更好的仿真重要,但不充分;要跨过去,必须补上真实世界的经验。

从“数据量”转向“数据质量”

行业当前的瓶颈,不只是数据量,而是数据质量与对齐程度。很多系统仍在从不完整/不同步的多源传感流学习,工程上只能用假设与补丁去填上下文的洞。这导致上线表现脆弱、可迁移性差。

仿真可以补一部分缺口,但替代不了现实的随机性与偶然性。想真正缩小 sim-to-real,必须让机器人摄入可信、贴部署场景的多模态经验:

而对于诺亦腾机器人(Noitom Robotics)来说,我们正在努力的事情,就是把这件事工程化:

终局目标:本能(Instinct)

有“本能(instincts)”的机器人不仅响应(react),还能预判(anticipate)。比如说物体将要滑落时,主动调整抓握力(adjust grip),再比如当人进入行进路径时,必须要先于碰撞减速;再比如把“昨天打开的抽屉今天可能仍半开”这件事情保存在记忆里。

而所有这些并不是硬编码规则(hard-coded rules)的堆叠,而是足量真实交互后自然涌现的行为模式。前提是持续、真实的多模态经验输入,且与目标环境域内一致。

Noitom Robotics 的定位

我们不直接造机器人本体。我们在人类能力与机器自主之间搭建桥梁:用数据与方法把物理硬件转化为“理解(understand)、适应(adapt)、融入(belong)”现实世界的智能体。

归根结底:智能,就是被提炼的经验(intelligence is just experience, distilled)。

联系我们(Get in touch)

如果你在做具身智能,正在为“如何给系统以真实世界的在场经验(lived experience)”而苦恼,欢迎交流——这是我们持续打磨的关键拼图。

Email us at: contact@noitomrobotics.com